E’ stato annunciato ufficialmente il 25 Ottobre 2019 sul suo blog Google scrive:

“il più grande passo avanti negli ultimi 5 anni e uno dei più grandi nella storia della Search”

parliamo di Google BERT.

Che cos’è BERT?

E’ una tecnica che si basa sulle reti neurali applicate alla gestione del linguaggio naturale. La rete neurale di Google per la pre-formazione sull’elaborazione del linguaggio naturale (PNL).

In breve, BERT può aiutare i computer a comprendere meglio il linguaggio degli umani, o verosimilmente, nello stesso modo di come fanno gli umani.

BERT è l’acronimo di Bidirectional Encoder Representations from Transformers.

L’idea è quella di analizzare meglio il significato completo di una frase nel suo insieme, invece di prendere ogni elemento a sé stante. In pratica anziché analizzare le singole keywords, Google con BERT dovrebbe riuscire a capire meglio i significato dell’intera frase per poi restituire una risposta migliore.

In questo modo si possono estrarre le vere e proprie richieste degli utenti, analizzandone anche il contesto.

Perché i SEO di tutto il mondo si stanno preoccupando?

Non solo perché Google ha affermato che questo cambiamento sta “rappresentando il più grande balzo in avanti negli ultimi cinque anni e uno dei più grandi balzi in avanti nella storia della ricerca”. Ma anche perché questo aggiornamento, per ora, influisce sul 10% di tutte le query.

Google ora usa le reti neurali per migliorare le tue ricerche

BERT ha iniziato a funzionare questa settimana e sarà completamente attivo a breve. È in fase di implementazione per le query in lingua inglese e si espanderà pian piano in tutte le altre lingue.

Quando viene utilizzato BERT?

Google ha affermato che BERT aiuta a comprendere meglio le sfumature e il contesto delle parole nelle ricerche e ad abbinare meglio quelle query con risultati più pertinenti. Verrà anche utilizzato per i Feautured Snippet, dei riquadri speciali di snippet in primo piano presenti nella parte superiore della pagina dei risultati di ricerca. Questi riquadri includono un riepilogo della risposta estratto da una pagina web, insieme a un link alla pagina, il relativo titolo e l’URL.

Alcuni esempi del funzionamento di BERT

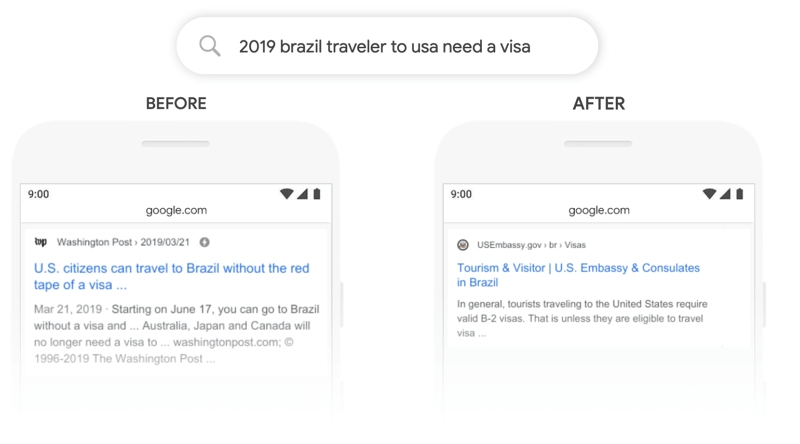

Google riporta questo esempio: con una ricerca di “2019 brazil traveler to usa need a visa” (un viaggiatore brasiliano negli Stati Uniti ha bisogno di un visto) la parola “to” e la sua relazione con le altre parole in questione sono importanti per comprenderne il significato. In precedenza, Google non capiva l’importanza di questa connessione e restituiva risultati sui cittadini statunitensi che viaggiano in Brasile. Mentre invece come si può capire la ricerca semanticamente riguarda l’opposto, e soprattutto se questi hanno bisogno di un VISTO. Con BERT, Google Search è in grado di cogliere questa sfumatura e sapere che la parola molto comune “to” in realtà conta molto qui, e può così fornire un risultato molto più pertinente per questa query”, e quindi i primi risultati mostrati forniranno informazioni su come ottenere un visto USA come brasiliano.

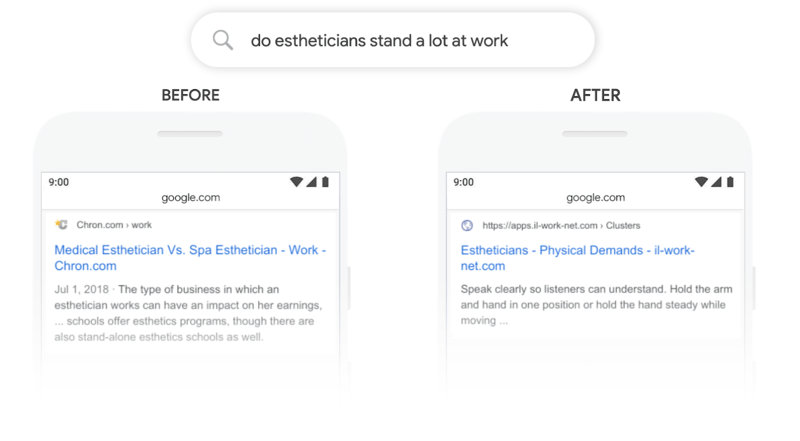

In un altro esempio, una ricerca di “do estheticians stand a lot at work”, (Gli estetisti stanno molto al lavoro) Google ha detto che in precedenza avrebbe abbinato il termine “stand-alone” (autonomo, in proprio) con la parola “stand” utilizzata nella query. Con BERT la search di Google può capire che “stand” è correlato al concetto delle esigenze fisiche di un lavoro e mostra una risposta più utile”, ha affermato Google.

Come è facile notare il focus del cambiamento riguarda soprattutto le ricerche più complesse, quelle fatte da frasi più lunghe. Infatti le ricerche su Google non riguardano più semplici keywords, ma sempre più frasi più articolate e complesse, e per stessa ammissione di Google, Search non è mai stato in grado di fornire risposte pertinenti con queste tipologie di ricerche molto lunghe o complesse.

In precedenza c’era RankBrain

RankBrain è stato il primo aggiornamento (Google Update) basato su machine learning (branca dell’intelligenza artificiale), utilizzato per comprendere le query, elaborare i risultati di ricerca di Google ed ordinarli adeguatamente. Lanciato nel 2015, RankBrain esamina sia le query sia il contenuto delle pagine web nell’indice di Google per comprendere meglio quali sono i significati delle parole.

BERT oggi fa un notevole passo avanti, non sostituisce del tutto RankBrain, ma è un metodo aggiuntivo per comprendere meglio contenuti e query. RankBrain rimane, e sarà comunque utilizzato per alcune query. Ma quando Google pensa che una query possa essere meglio compresa con l’aiuto di BERT la utilizzerà. In effetti, una singola query può utilizzare più metodi, incluso BERT, per comprendere la query.

Riusciranno i SEO ad ottimizzare i propri contenuti per BERT?

Credo che sarà molto difficile, o meglio, non si potrà più “bluffare” utilizzando keywords o frasi a volte mal articolate da punto di vista sintattico, ma ben costruite per migliorare il posizionamento su google. Big G già da tempo, con i suoi infiniti Google Algorithm Updates, si muove verso la massima comprensione dei contenuti, ma aggiornamenti come BERT fanno un notevole passo avanti perché si concentrano sulla comprensione delle ricerche, restituendo poi la migliore risposta.

Google stesso aveva annunciato già con RankBrain che i SEO non possono davvero ottimizzare il loro lavoro, sarà quindi ancora più difficile oggi.

Il primo consiglio da SEO?

Se Google sta migliorando nel comprendere il linguaggio naturale, dobbiamo sempre più concentrarci nello scrivere contenuti di valore per gli utenti, contenuti unici, che siano interessanti e che forniscano informazioni utili e autorevoli.

Domenico Rastelli – Consulente Internet Marketing

Per consulenze SEO e Web Marketing: Geminit Internet Marketing